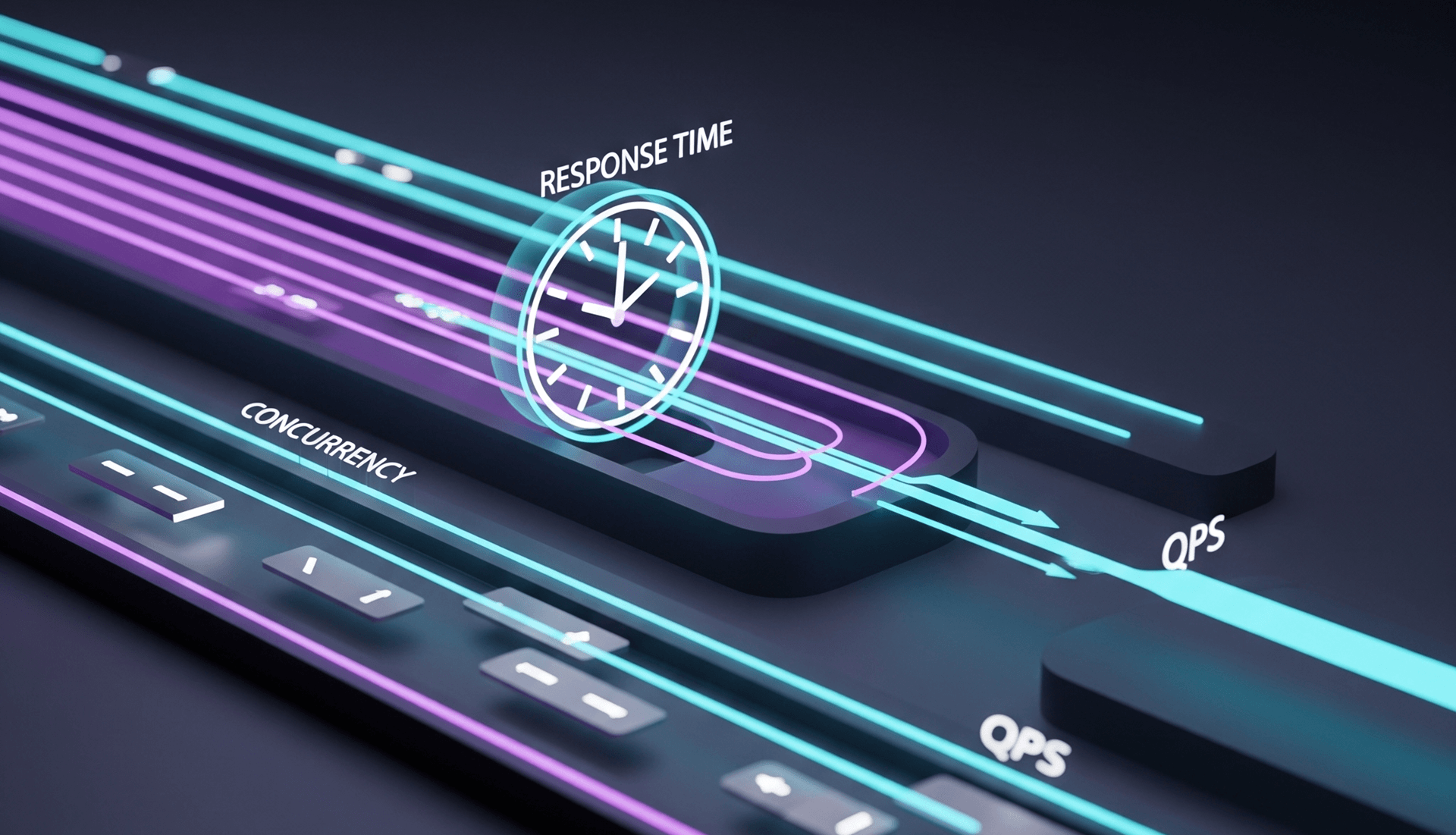

深入浅出讲解 QPS、并发数与响应时间之间的逻辑关系,通过“传送带模型”解析长耗时接口下的性能迷思,助你掌握后端优化的核心法则。

1. 别把 AI 当成“过目不忘”的神

很多人被 2026 年大模型宣传的“百万 Token 上下文”给洗脑了,觉得只要把整个项目塞进去,AI 就能永远记住。

事实是:AI 的记忆力更像是一个“桌面”,而不是“硬盘”。

想象你在工作,你的办公桌(上下文窗口)虽然很大,可以铺开很多图纸。但随着你谈话的深入,桌上堆满了废弃的草稿、报错的日志、还有没关上的咖啡杯。

-

结果: 真正重要的那张“核心架构图”,可能被压在了最底下。

-

后果: AI 并不是忘了规则,而是它在满桌子的杂物中,“注意力”被稀释了。

2. 名词扫盲:关于“记忆”的专业黑话

要在圈子里混,或者看懂编译器的后台日志,这几个词你得烂熟于心:

-

Tokens(令牌): AI 世界的“耗材单位”。一段代码、一句话,甚至一个标点符号,都会被切成 Token。你的上下文窗口就是由这些 Token 撑起来的。

-

Attention(注意力机制): AI 不是一行行读代码,它是跳着看的。它会给重要的信息(如类定义)加权重,给不重要的(如注释、垃圾逻辑)减权重。

-

Context Pollution(上下文污染): 这是一个非常形象的词。如果你在之前的对话里写了一段错的代码,这段代码就会留在 AI 的记忆里。当你问新问题时,它会参考这段错代码给你写新代码。这就是为什么 AI 会“越聊越蠢”。

3. 为什么 AI 越写越乱?(注意力的“边际递减”)

这是 2026 年 AI 编程中一个极具迷惑性的点:对话越长,风险越高。

当你在一个对话框里停留太久:

-

噪音增加: 你反复修改 Bug 的过程,对 AI 来说都是“噪音”。它分不清哪段代码是最终版,哪段是测试版。

-

幻觉加剧: 当上下文窗口接近满载时,AI 为了节省资源,会开始“走捷径”。它不再去翻索引,而是凭感觉去猜你的逻辑。

-

架构漂移: 它可能会突然抛弃你原本干净的模式,转而采用一种它认为“更快捷”但完全不符合规范的写法,因为它此时的“大脑”已经太累了。

4. 2026 年的“Token 焦虑”:为什么性能会变差?

你可能发现,对话时间长了以后,AI 生成代码的速度会变慢,甚至会断断续续。

这不是网络问题,而是模型在处理海量上下文时,计算量呈指数级增长。每一次你发送新指令,IDE 都要把之前那几万个 Token 重新过一遍。这种巨大的开销,不仅费钱(如果你用的是按量计费),更消耗了 AI 的“智商”。

💡 结语

理解了上下文窗口,你就会明白:AI 的记忆不是无限的,也不是无暇的。 在实战中,高手和菜鸟的区别就在于:菜鸟试图让 AI 记住一切,而高手则在不断地**“帮 AI 删减记忆”**。如果你发现 AI 开始不听话,最好的办法不是继续教育它,而是意识到:它的办公桌已经乱得没法干活了。

📅 下一篇预告

既然 AI 的记忆会“过期”也会被“污染”,那我们该怎么管?

下一篇,咱们聊聊那个被无数人忽视的文件夹:【索引治理:为什么 .gitignore 是 AI 编译器里最重要的配置文件?】。我们要讲讲如何通过“物理隔离”,让 AI 只看该看的东西,彻底闭上它那双爱看“垃圾代码”的眼睛。

延伸阅读:

【2026 AI 编程系列二】深入浅出解析 AI 原生 IDE 的核心技术——RAG(检索增强生成)。科普 AI 是如何通过建立索引、向量搜索来“偷看”并理解你的整个代码库,带你识破 AI “幻觉”背后的底层逻辑。

【2026 AI 编程系列一】深度剖析 AI 原生 IDE 的诞生背景与核心本质。从编辑器进化史的角度,解释为什么传统的 IDE 插件已无法满足现代开发需求,带你重新认识这个正在改变程序员工作方式的“新物种”。

深入探讨 2026 年 AI 编程普及背景下程序员的核心竞争力。分析 AI 生成代码带来的隐形技术债,强调架构设计与底层系统运维在“代码通胀”时代的重要性。本文为开发者提供了从“编码者”向“系统编排者”转型的实战路线图,剖析如何在高度自动化的开发流程中建立不可替代的个人护城河。

写给程序员的2026生存指南:告别无效技术内卷,聚焦AI Agent开发、低代码开发、性能优化3个高价值方向,分享程序员成长干货,助力开发者做有价值的技术人。

2026年五大科技风口深度解析:具身智能、AI Agent、新型储能、低空经济、合成生物学,从落地场景到产业机遇,拆解科技变革下普通人能抓住的成长方向,读懂未来科技发展趋势。